افسار هوش مصنوعی سرکش توسط آمریکا کشیده خواهد شد؟0000

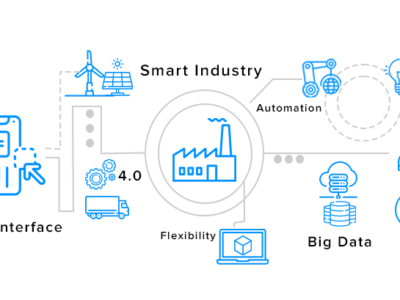

معاون رئیس جمهور، کامالا هریس، روز پنجشنبه با روسای گوگل، مایکروسافت و دو شرکت دیگر که هوش مصنوعی را توسعه می دهند، ملاقات کرد، زیرا دولت بایدن ابتکاراتی را به منظور اطمینان از پیشرفت سریع فناوری بدون به خطر انداختن حقوق و ایمنی مردم، بهبود می بخشد. دولت دموکرات از سرمایه گذاری 140 میلیون دلاری برای ایجاد هفت موسسه تحقیقاتی جدید هوش مصنوعی خبر داد.

افسار هوش مصنوعی سرکش توسط آمریکا کشیده خواهد شد؟0000

علاوه بر این، انتظار میرود که دفتر مدیریت و بودجه کاخ سفید در چند ماه آینده راهنماییهایی درباره نحوه استفاده آژانسهای فدرال از ابزارهای هوش مصنوعی صادر کند. همچنین توسعه دهندگان برتر هوش مصنوعی تعهد مستقلی برای شرکت در ارزیابی عمومی سیستم های خود در ماه آگوست در کنوانسیون هکرهای لاس وگاس DEF CON دارند.

جلسه پنجشنبه برای هریس و مقامات دولتی طراحی شد تا در مورد خطراتی که در توسعه هوش مصنوعی فعلی می بینند با مدیران عامل گوگل، مایکروسافت و دو استارت آپ تاثیرگذار که آنها حمایت می کنند صحبت کنند: OpenAI تحت حمایت مایکروسافت و Anthropic تحت حمایت گوگل. پیام رهبران دولت به شرکت ها این است که آنها نقشی در کاهش ریسک ها دارند و می توانند با دولت همکاری کنند.

مقامات بریتانیا نیز روز پنجشنبه گفتند که در حال بررسی خطرات مرتبط با هوش مصنوعی هستند. ناظر رقابت بریتانیا اعلام کرد که در حال بازبینی بازار هوش مصنوعی با تمرکز بر فناوری زیربنای چت رباتهایی مانند ChatGPT است که توسط OpenAI توسعه یافته است.

هوش مصنوعی

رئیس جمهور جو بایدن ماه گذشته اشاره کرد که هوش مصنوعی می تواند به مقابله با بیماری ها و تغییرات آب و هوایی کمک کند، اما همچنین می تواند به امنیت ملی آسیب برساند و اقتصاد را به روش های بی ثبات کننده مختل کند. بایدن نیز در این مراسم روز پنجشنبه متوقف شد. به گفته یکی از مقامات کاخ سفید، او به طور گسترده در مورد ChatGPT توضیح داده شده است، نحوه عملکرد آن را دیده و حتی با این ابزار آزمایش کرده است.

انتشار ChatGPT در اواخر سال گذشته منجر به افزایش بحث در مورد هوش مصنوعی و نقش دولت در این فناوری شد. توانایی ابزارهای جدید «هوش مصنوعی مولد» برای تولید نوشتههای انسانمانند و تصاویر جعلی بر نگرانیهای اخلاقی و اجتماعی در مورد سیستمهای خودکار افزوده است.

برخی از شرکت ها، از جمله OpenAI، در مورد داده هایی که سیستم های هوش مصنوعی آنها آموزش دیده اند، مخفیانه عمل کرده اند. این موضوع درک اینکه چرا یک ربات چت به درخواستها پاسخهای مغرضانه یا نادرست ارائه میکند یا رسیدگی به نگرانیها در مورد سرقت آثار دارای حق چاپ را دشوارتر میکند.

مارگارت میچل، دانشمند ارشد اخلاق در استارتآپ Hugging Face، گفت: شرکتهایی که نگران مسئولیت چیزی در دادههای آموزشی خود هستند، ممکن است انگیزهای برای ردیابی دقیق آن نداشته باشند.

میچل در مصاحبهای در روز سهشنبه گفت: «من فکر میکنم ممکن است OpenAI امکان نداشته باشد که تمام دادههای آموزشی خود را در سطحی از جزئیات که واقعاً از نظر برخی از نگرانیهای مربوط به رضایت، حفظ حریم خصوصی و مجوز مفید باشد، جزئیات دهد. با توجه به آنچه که من از فرهنگ فناوری می دانم، این کار انجام نشده است.

از نظر تئوری، نوعی قانون افشا میتواند ارائهدهندگان هوش مصنوعی را وادار کند تا سیستمهای خود را برای بررسی دقیقتر شخص ثالث باز کنند. اما با توجه به اینکه سیستمهای هوش مصنوعی بر روی مدلهای قبلی ساخته شدهاند، ارائه شفافیت بیشتر بعد از این واقعیت برای شرکتها آسان نخواهد بود.

میچل گفت: «من فکر میکنم این واقعاً به دولتها بستگی دارد که تصمیم بگیرند که آیا این بدان معناست که شما باید تمام کارهایی را که انجام دادهاید به سطل زباله بریزید یا نه». «البته، من به نوعی تصور می کنم که حداقل در ایالات متحده، تصمیمات به سمت شرکت ها می رود و از این واقعیت حمایت می کند که قبلاً انجام شده است. اگر همه این شرکت ها مجبور شوند اساساً همه این کارها را هدر دهند و از نو شروع کنند، چنین پیامدهای عظیمی خواهد داشت.»

در حالی که کاخ سفید روز پنجشنبه یک رویکرد مشترک با این صنعت را نشان داد، شرکتهایی که از هوش مصنوعی میسازند یا استفاده میکنند نیز با نظارت شدید آژانسهای ایالات متحده مانند کمیسیون تجارت فدرال، که قوانین حمایت از مصرفکننده و ضد انحصار را اجرا میکند، مواجه هستند.

این شرکتها همچنین با قوانین سختگیرانهتری در اتحادیه اروپا روبرو هستند، جایی که مذاکرهکنندگان در حال انجام اقدامات تکمیلی بر روی مقررات هوش مصنوعی هستند که برای اولین بار دو سال پیش پیشنهاد شد. این قوانین می تواند بلوک 27 کشوری را در خط مقدم فشار جهانی برای تعیین استانداردهای این فناوری قرار دهد.

هنگامی که اتحادیه اروپا برای اولین بار در سال 2021 پیشنهاد خود را برای قوانین هوش مصنوعی ارائه کرد، تمرکز بر مهار برنامه های پرخطری بود که ایمنی یا حقوق افراد را تهدید می کند، مانند اسکن صورت زنده یا سیستم های امتیازدهی اجتماعی دولتی، که افراد را بر اساس رفتارشان قضاوت می کنند. به ندرت به چت بات ها اشاره شد.

اما در بازتاب سرعت توسعه فناوری هوش مصنوعی، مذاکره کنندگان در بروکسل در تلاش برای به روز رسانی پیشنهادات خود برای در نظر گرفتن سیستم های هوش مصنوعی با هدف عمومی هستند. طبق پیش نویس بخشی از قانون اخیر که توسط آسوشیتدپرس به دست آمده است، مفاد اضافه شده به این لایحه به مدل های به اصطلاح بنیادی هوش مصنوعی نیاز دارد تا مطالبی را که برای آموزش سیستم ها استفاده می شود را افشا کنند.

مدلهای بنیادی زیرمجموعهای از هوش مصنوعی عمومی هستند که شامل سیستمهایی مانند ChatGPT میشود. الگوریتم های آنها بر روی استخرهای وسیعی از داده ها آموزش داده شده است.

نظرات